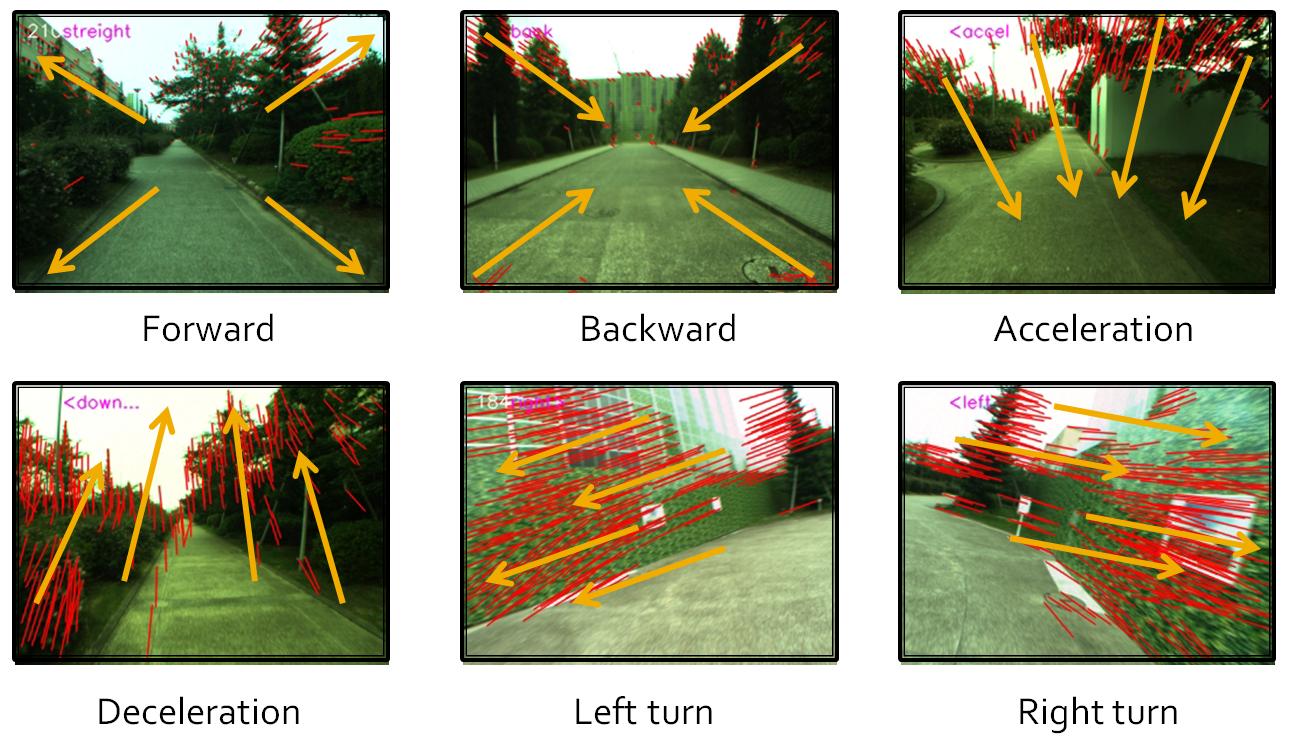

Segwayは運転者が体重移動やハンドルバーを傾ける操作により前進や後退,加減速,右左折などをコントロールするため,

自動車など通常の車載カメラと比較するとカメラの姿勢が走行状況により大きく変化します.

このため,下向けカメラから得られた地面やフロアの画像パターンの時間的な変化を走行状況をまず確実に捉えます.

左図は前進,後退,加速,減速,右折,左折時の下向きカメラの画像とそのオプティカルフロー(赤線)です.

このオプティカルフローの方向と長さにより各時点での走行状況と速度を推測します.

Segwayは運転者が体重移動やハンドルバーを傾ける操作により前進や後退,加減速,右左折などをコントロールするため,

自動車など通常の車載カメラと比較するとカメラの姿勢が走行状況により大きく変化します.

このため,下向けカメラから得られた地面やフロアの画像パターンの時間的な変化を走行状況をまず確実に捉えます.

左図は前進,後退,加速,減速,右折,左折時の下向きカメラの画像とそのオプティカルフロー(赤線)です.

このオプティカルフローの方向と長さにより各時点での走行状況と速度を推測します.

|

|

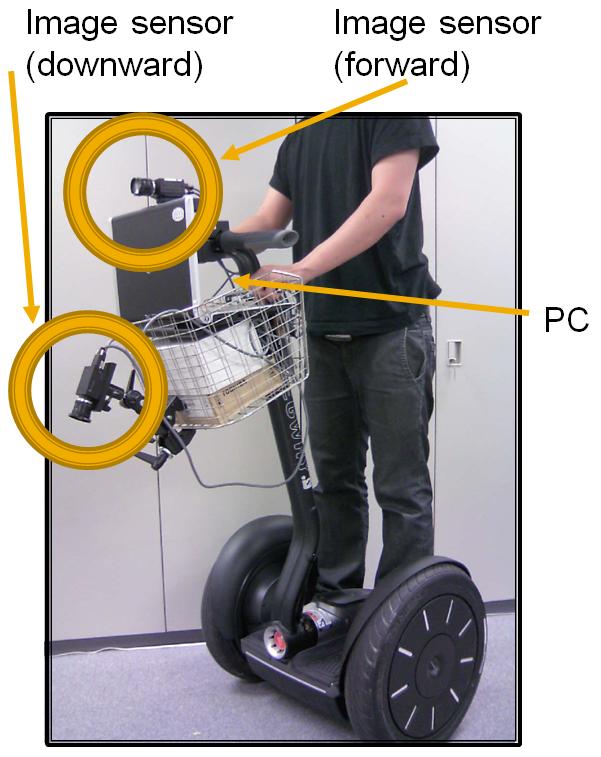

本研究は次世代パーソナルビークルと言われているSegwayの安全走行を支援するために,

複数のカメラをSegwayに搭載し得られる画像を処理することで

Segwayの走行状況および走行中のSegwayの前方を歩行者などの危険な移動物体を検出しようというものです.

左図に示すように本研究では前方に向けたカメラだけでなく,

斜め下方向を捉えるカメラをSegwayに設置します.

本研究は次世代パーソナルビークルと言われているSegwayの安全走行を支援するために,

複数のカメラをSegwayに搭載し得られる画像を処理することで

Segwayの走行状況および走行中のSegwayの前方を歩行者などの危険な移動物体を検出しようというものです.

左図に示すように本研究では前方に向けたカメラだけでなく,

斜め下方向を捉えるカメラをSegwayに設置します.

Segwayは運転者が体重移動やハンドルバーを傾ける操作により前進や後退,加減速,右左折などをコントロールするため,

自動車など通常の車載カメラと比較するとカメラの姿勢が走行状況により大きく変化します.

このため,下向けカメラから得られた地面やフロアの画像パターンの時間的な変化を走行状況をまず確実に捉えます.

左図は前進,後退,加速,減速,右折,左折時の下向きカメラの画像とそのオプティカルフロー(赤線)です.

このオプティカルフローの方向と長さにより各時点での走行状況と速度を推測します.

Segwayは運転者が体重移動やハンドルバーを傾ける操作により前進や後退,加減速,右左折などをコントロールするため,

自動車など通常の車載カメラと比較するとカメラの姿勢が走行状況により大きく変化します.

このため,下向けカメラから得られた地面やフロアの画像パターンの時間的な変化を走行状況をまず確実に捉えます.

左図は前進,後退,加速,減速,右折,左折時の下向きカメラの画像とそのオプティカルフロー(赤線)です.

このオプティカルフローの方向と長さにより各時点での走行状況と速度を推測します.

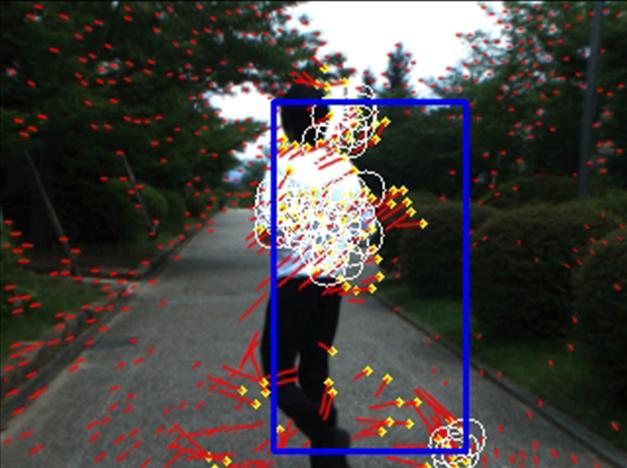

左図は前向きカメラから得られる前方画像とそのオプティカルフローです.

下向きカメラ画像を解析することにより得られる走行状況と速度から

前向きカメラ画像に現れる「はず」のオプティカルフローを推測し,

その推測から外れた動きを示す領域を検出することで車両前方を横切る人などの移動物体を安定して捉えます.

実験の結果,運転者に警告してから安全に停止できる時間的猶予をもって移動物体を検出できることがわかりました.

左図は前向きカメラから得られる前方画像とそのオプティカルフローです.

下向きカメラ画像を解析することにより得られる走行状況と速度から

前向きカメラ画像に現れる「はず」のオプティカルフローを推測し,

その推測から外れた動きを示す領域を検出することで車両前方を横切る人などの移動物体を安定して捉えます.

実験の結果,運転者に警告してから安全に停止できる時間的猶予をもって移動物体を検出できることがわかりました.